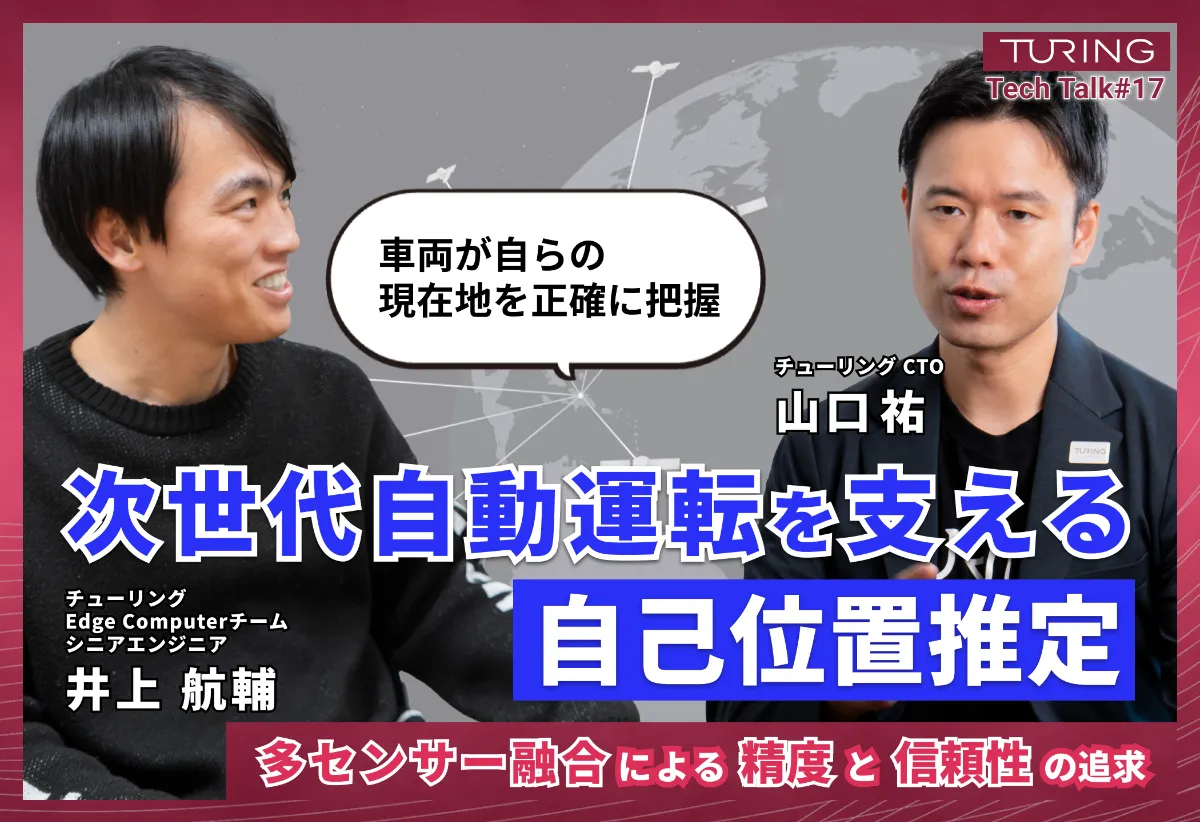

Turing Tech Talk 第17回 「次世代自動運転を支える自己位置推定 多センサー融合による精度と信頼性の追求」

2025年5月1日、チューリングではTuring Tech Talk 第17回 「次世代自動運転を支える自己位置推定 多センサー融合による精度と信頼性の追求」と題したオンラインイベントを開催しました。

今回は、我々が自動運転を実現するにあたって、精度の高い自己位置推定を可能とするためにどのようなアプローチを取っているのかを、深掘りしてお話ししました。当社のCTOである山口祐、シニアソフトウェアエンジニアの井上航輔が登壇し、現場とマネジメント双方の目線から解説を行いました。当日の模様を、イベントレポートとしてお届けいたします。

山口: 皆さんこんにちは。Turing Tech Talk 第17回「次世代自動運転を支える自己位置推定 多センサー融合による精度と信頼性の追求」をはじめます。私はチューリング CTOの山口です。本日はよろしくお願いします。

これまで自動運転に関するさまざまなテーマを取り上げてきましたが、今回のTuring Tech Talkは「自己位置推定回」と題して、よりセンサーに近い領域を深掘りしチューリングがどのように取り組んでいるかをお話しできればと考えております。

まずは本日の登壇者の紹介をさせていただきます。Edge Computerチームのシニアソフトエンジニアである井上です。入社してから、今日のテーマでもある自己位置推定に取り組んでいただいています。チューリングに入社してどのくらいになりますか?

井上: 今年1月の頭に入社しましたので、4ヶ月ほどになります。

山口: 具体的にこれまでのご経歴や自己紹介をお願いできますか。

井上: 改めて、井上航輔と申します。私の簡単な経歴ですが、大学院までは農業用ロボットの位置推定やナビゲーションに関する研究をしており、特にカメラを中心としたビジュアルSLAMの研究を行っていました。その後、本田技術研究所に入社し、小型船舶や移動ロボットの自己位置推定や周囲認識技術の研究開発を経験しました。そして、2025年1月からチューリングに入社し、GNSSとIMUを組み合わせた高精度な自己位置推定に携わっています。

山口:それでは、今回のテーマである自己位置推定に入っていきたいと思います。チューリングはEnd-to-End(E2E)自動運転AIで、東京や世界の道路を走るモデルを開発しています。このような新しい技術を実現するためには、自己位置推定が非常に重要なタスクとなります。なぜそれが重要なのか、そしてどのように実現していくのか、深掘りできればと考えています。

これまで自動運転は、センサーからの入力情報を認識するモジュール、動きを予測するモジュール、走行計画を立てるモジュールといったように、さまざまなモジュールに分かれてそれぞれに応じたアルゴリズムや機械学習モデルが用いられていました。

しかし私たちはそうではなく、最近のAIの潮流でもあるように、単一の大きなニューラルネットワークで入力から出力(操作)まで、End-to-Endで一気通貫に処理するモデルに取り組んでいます。弊社ではこのEnd-to-Endモデルを「TD1」と名付け、現在自社で開発し、公道でのテストも行っています。

また、弊社は自社でデータ収集を行っています。東京のあらゆる道、総延長で5,000kmを超える広範囲の道をデータ収集車両で走り、データを取得しています。データ量で言えば数PB、そろそろ10PBに到達する勢いです。このような大量のデータを学習に用いてAIモデルを訓練しています。

ただし、そのデータは単にカメラで撮影しているだけではなく、さまざまなセンサーデータを統合し、AIモデルの教師データ、つまり正解データとして使えるように加工する必要があります。本日はその中でも、車両が今後どのように走行するのか、自分が現在道路のどこにいるのかを判断する技術についてお話ししたいと思います。

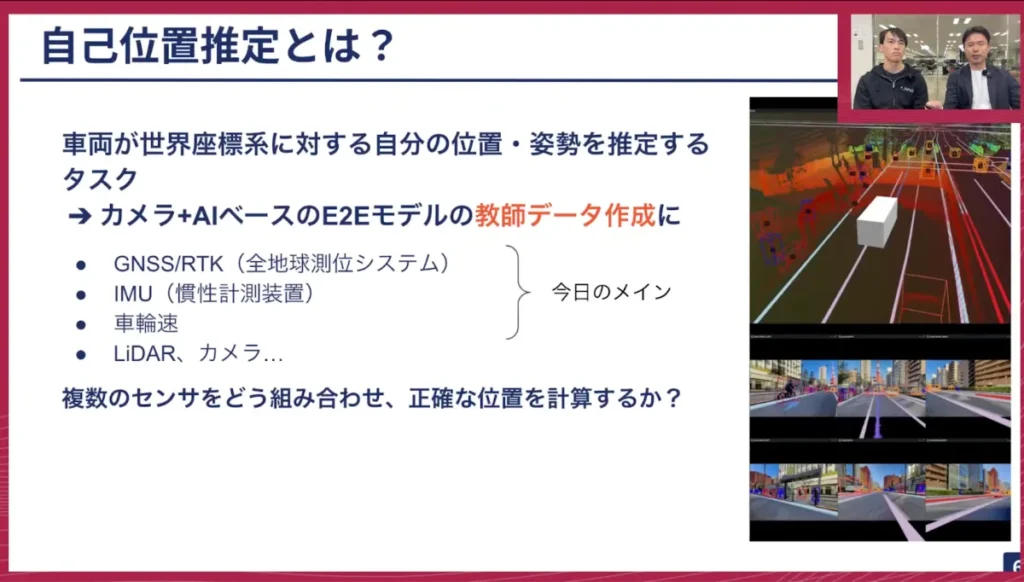

山口: 今日のタイトルでもある「自己位置推定」とは文字通り、自己の位置を推定するタスクですが、これはロボットや自立移動車両といった物体に対して行われる、比較的古典的なタスクの一つです。

人間は「自分が今どこにいるか」について感覚でわかる一方で、ロボットは自分が今どこにいるかを正確に把握することは難しいタスクです。

これを踏まえて、専門的には「世界座標系」と言いますが、つまり我々の空間における絶対的な座標系の中で、自分がどこに位置しているか、あるいはどの方向を向いているかを推定するのが自己位置推定のタスクになります。

私たちは自動運転のアプローチとして、RGBの通常のカメラと非常に高性能なAIを組み合わせてE2Eモデルを構築していますが、この自己位置推定はリアルタイムでの車両制御にはあまり使用していません。

では何に使っているかというと、E2Eモデルを学習する際の教師データ、つまりAIを学習するためのデータを作成する際に積極的に活用しています。

この自己位置推定にどのような技術が必要かについては、この後井上からも詳しくお話しますが、概要としてはGNSS(GPSと一般的に呼ばれるもの)、IMU(慣性計測装置)、そして車両の車輪速度、つまりタイヤがどのくらいのスピードで回転しているか、車がどのくらいのスピードで進んでいるかといった情報を組み合わせることで、自分の位置を推定できるアルゴリズムを開発しています。その他にもLiDARやカメラから自分の位置を推定する技術もありますが、今日のメインはGNSS、IMU、車輪速度の3つの組み合わせについてです。

では複数のセンサーから自分の位置を正確に推定するとは、そもそもどのように行うのでしょうか。ここからは、専門家である井上が、詳細を解説しながら深掘りしていこうと思います。それではよろしくお願いします。

井上: よろしくお願いします。次世代自動運転を支える自己位置推定について説明していきます。

現在チューリングが開発している次世代の自己位置推定用センサーシステムは、この車の絵に示されているようなかたちとなっています。車両のルーフの上の方に、衛星測位のためのアンテナが2つ搭載されています。中央にはLiDARというレーザーを出して距離を測る装置が搭載される予定です。そして、先ほど説明のあったIMU(車の加速度、どれだけ早くスピードを上げたり減速したりするかを測る)と、速度を測るセンサーが各車輪に搭載されています。また、周囲を認識するためのカメラも全周に搭載されています。

山口: 少しお伺いしたいことがあります。これはいわゆる弊社の車両に搭載するためのセンサー群だと思いますが、基本的に我々が車両を実際に動かす際の推論にはカメラだけを使用しており、センサーはデータ収集時に使っているということになりますか?

井上: その通りです。

山口: 自動運転の歴史を振り返ると、2000年代の初め頃からLiDARやその他のリッチな高性能センサーを多数使用して車両を正確に制御する技術が発達してきました。しかし、我々はそれとは異なる潮流でカメラベースのアプローチをとっています。それでも、カメラだけで判定するAIを開発するために、これらの様々なセンサーを使って車両の自己位置を推定しているということですね。

井上:次に、現在チューリングで開発しているセンサーのモジュールについてです。ボックス型のもので、この中に衛星測位のためのモジュールやIMUを搭載するための電子基板を作成し、それを車両に搭載するためのセンサーモジュールを開発しているところです。

山口: ありがとうございます。いきなりセンサーモジュールの開発が出てきて少し驚きましたが、一般的に普通の会社はこのようなセンサーモジュールを開発するものなのですか?

井上: いえ、おそらくほとんどの場合は自己位置推定ができるモジュールとして市販されているものを購入し、それを車に搭載してデータを取得するという流れになるかと思います。

山口: なるほど。しかし、弊社は今これをオリジナルで、センサーモジュールやセンサーシステムを構築しようとしているのですね。なぜ自社で開発しようとしているのですか?

井上: 市販品ですと、自己位置推定にどのようなアルゴリズムを使用し、どのような計算を経て最終的な位置が出力されるのかがブラックボックス化されており、メーカーも教えてくれないことがあります。そうなると、例えば「本当はこの位置を取得したいのに取れていないが、どうしたらいいだろう」という状況に直面した際に、それを改善する手段がなくなってしまいます。そのため、自己位置推定の技術を自社で保有することが、取得できるデータの幅広さやバリエーション、品質を確保するために必要であるという理由から、このセンサーモジュールを開発しているところです。

山口: つまり市販品では一定の精度は得られるものの、究極の精度や細かい改善を追求しようとすると、自社でモジュールから開発してソフトウェアを構築する必要があると。さらに、その精度やシステムへの組み込みを考えると自社で開発するしかないということですね。ちなみにこれはハードウェア開発ということで、例えばこのセンサーも自社で製造しているのですか?

井上: センサーそのものとなると半導体の製造なども発生するので、IMUであれば車両用・自動運転用のIMUを選定し、我々のニーズに合ったものを選択して基板設計を行っています。

山口: ありがとうございます。それでは、今このセンサーモジュールの筐体側の箱の話が出ましたが、この中に基板があり、その中に他のメーカーから購入した専用のセンサーが基板上に配置されているということですね。

この基板の設計なども自社で行っているのですか?

井上: はい、そうです。基板も電子部品をどこに配置するか、例えば一番右側にあるGNSSの衛星を受信するアンテナのケーブルが差し込まれる部分の基板配線であったり、電源設計、つまりどれくらいの電力を使うかといった設計であったり、例えばバッテリーを逆に接続してしまった際に内部回路が保護されるかどうかといった設計まで行っています。

山口: なるほど。自分たちで回路設計や機能のデザインを行いながら、実際に完成した際にはソフトウェア的な部分も含めて自分たちで開発していき、まさにセンサーシステムを内製化しようとしているのですね。

端子の話が出たので少しお伺いしたいのですが、手前についているのがおそらくIOの部分で、SMAの同軸アンテナに接続する端子が2つありますね。先ほどのスライドにもありましたが、アンテナが2つ付いています。なぜ、アンテナを2つ付けるのですか?

井上: GNSSの衛星測位では、アンテナが1つでも位置は算出できます。しかし、自己位置推定には現在位置だけでなく、どちらの方向を向いているかという情報も必要になります。アンテナが2つあると、それぞれのアンテナからの情報によってどちらの方向を向いているかがわかります。そのためにアンテナを2つ搭載しています。

山口: なるほど。つまり、XYZ座標だけでなく、ヨー、ロール、ピッチといった自分の向きまで知ろうとするとアンテナが複数必要で、その情報を使いたいということですね。

それ以外の端子は何ですか? これはLANですか?

井上: イーサネットです。これも2つ付いており、データ通信用になります。

山口: チューリングの車載システムは現在イーサネットで計算機や様々なセンサーを接続していますが、そこに繋がるようになっているのですね。あとはUSBですか?

井上: 一番左はCANです。CANは車両の情報を取得するためのポートが一番左にあります。

山口: なるほど、分かりました。このあたりのイーサネットの端子などからすると、かなり小さいですよね。

井上: そうですね。お弁当サイズというか、手のひらより少し大きいかな、くらいのサイズ感ですね。

山口: この中に、今日この後も深掘りしていくようなセンサーや機能が詰め込まれているということですね。これは楽しみです。ちなみにEdge Computerチームで開発されているそうですが、現在何人くらいで開発されているのですか?

井上: 私を含めて5人で開発しています。この筐体も1週間〜2週間前に設計し始めて、すでにこんなにかっこいい筐体ができており凄いスピード感です。

山口: ちなみに、いつ頃完成させたいといったタイムラインで進めているのですか?

井上: 今この試作段階なのですが、この試作モジュールが、来月(5〜6月)くらいには中の基板などもインテグレートされた状態のものが出来上がって、しっかりと性能的にも動くかの検証が始められると思います。

山口: ありがとうございます。では、この中身についてさらに詳しくお聞きしたいです。

井上: 先ほどから衛星測位についてお話ししてきましたが、これはGPSとよく呼ばれる、スマートフォンなどでGoogleマップで現在位置を計測するために人工衛星から情報を受信して自分の位置を測るものです。

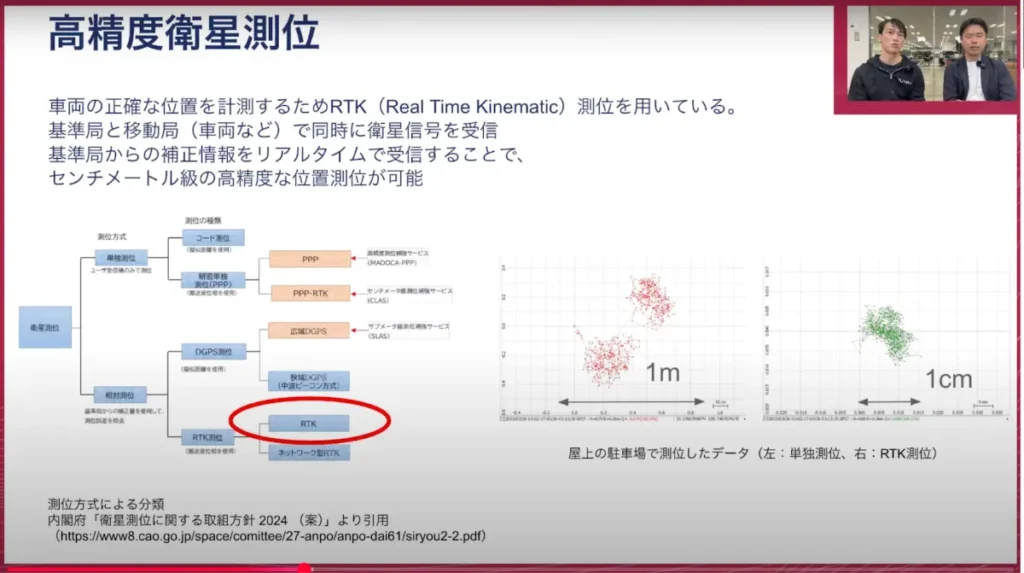

実はこの衛星測位にも、左側の図のようにたくさんの種類があります。その中でチューリングの自動運転データ収集では、赤丸で示された「RTK測位」を使用しています。このRTK測位は、日本全国に配置されている「基準局」から情報を受信することで、精度を向上させる測位方法です。

右側の図は実際に取得したデータで、左側はRTKではない「単独測位」の結果です。ここは非常に開けた場所で屋上の駐車場なので、特に遮蔽物やビルがないにもかかわらず、データを取得してみると、位置がだいたい1m四方の範囲でばらついています。

対してRTK測位という精度向上計算を行ったものが、右側の緑色の点群です。RTK測位を用いると、精度を1cm程度まで向上させることができます。

山口: 1mと1cmでは100倍も違うということですね。最近、GPSやGNSSでCM級の精度という言葉も耳にするようになりましたが、このRTKとはどのような仕組みで基準局から情報を受け取るのでしょうか? もう少し詳しく教えていただけますか。

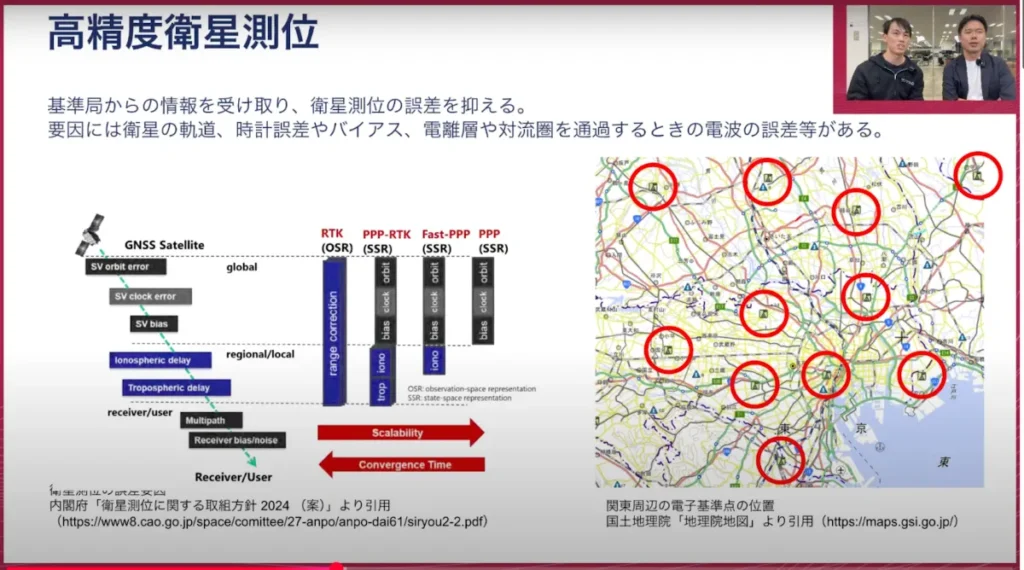

井上: まず衛星測位といっても、そのまま計算すると多くの誤差が含まれます。衛星の位置情報にもわずかなずれがあったり、衛星に搭載されている時計にも誤差があったりします。

他にも衛星から電波が私たちのアンテナまで届くまでの間に、電離層という空の上層部に紫外線などの影響で電子が浮遊している層があり、そこで電波の到達にわずかな誤差が生じます。さらに下の対流圏という雲などが形成される層でも電波に誤差が生じるなど、様々な誤差が重なって、最終的に先ほど見たように1m程度ずれてしまうのです。

RTK測位では、基準局と移動局との情報を比較することで、誤差をキャンセルして引き算し、精度を向上させるものになります。

右側の赤丸がついた図は国土地理院が設置している「電子基準点」と呼ばれるもので、日本各地にアンテナが設置されています。関東地方だとこれくらいの数があり、これらは測量などによく使われます。

山口: この電子基準点はRTK測位でも使われるのですか?

井上: 使われることもあります。国が測量を行っているので、それに対して他の場所の測量を行いたい場合は、これらの電子基準点を使用します。最近ではRTK測位のための補正情報を配信してくれるサービスも増えており、それらのサービスでも様々な場所にアンテナを設置して情報を提供してくれています。

山口: ありがとうございます。このRTKがいかに高精度かというところで、そもそも原理的にはGNSSは衛星が3つか4つあれば自分の位置が正確に定まるはずですが、やはり様々な要因で誤差が生じてそれが1m程度のずれになってしまうのですね。しかし、それを別の基準点からの情報と組み合わせることで、本来GNSSが引き出せるであろう性能を最大限に発揮できるのがRTKの最大のポイントなのですね。

井上: その通りです。

山口: ありがとうございます。ちなみに、このRTKはおそらくインターネットでこの基地局と通信し、後で受信した情報を補正するような形ですね。RTKはサービスとして提供されているのですか?

井上: はい。通信関係のドコモさんやソフトバンクさんなどが最近「補正情報サービス」として、RTKを行うための誤差をキャンセルする情報を配信しており、登録すればその情報を受け取ることができます。

山口: それでは、ユーザー、つまり私たちのような立場は、その情報を受け取って自社のセンサー情報と組み合わせて、リアルタイムで自分の位置を補正しながら使用していく形なのですね。非常によく分かりました。

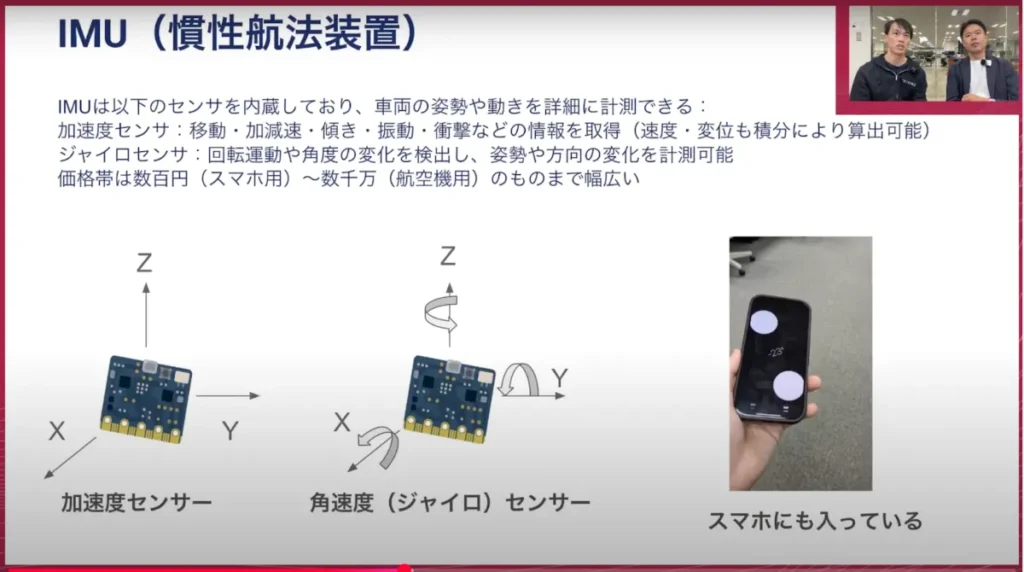

井上: 次に、先ほど説明のあったIMUについてです。IMUは日本語では「慣性航法装置」と

呼ばれ、慣性力、つまり車両がどれくらいのスピードで加速したり減速したりしているかを測るセンサーです。

IMUの中身は大きく2つの役割に分かれます。まず1つは加速度センサーです。例えば、ブレーキを強く踏むと車両の速度が遅くなりますが、その減速の度合いを測ります。もう1つはジャイロセンサーです。これはスマートフォンにも搭載されており、ゲーム機などにも入っているものです。角速度、つまりどれくらいの速さで回転しているかを測ります。例えば車両がカーブを曲がる際に、どれくらいの速さで曲がっているかを測るのがこのジャイロセンサーです。この2つが搭載されているのがIMUです。

今、右側にiPhoneの画像がありますが、これはiPhoneの「水準器」という機能で、IMUを使用しています。重力の力が常に下にかかっているので、それによって現在どれくらい傾いているかが分かるというIMUの簡単な例になります。

スマートフォンに搭載されているものは、おそらく数円、もしかすると数十円といった非常に安価なものもありますが、非常に安価なものはそれだけ精度が悪かったりします。一方、例えば航空機などに搭載されている高価なものは数千万円、もしかすると億を超えるものもあるため、金額の幅は非常に広いです。

山口: ありがとうございます。このIMUですが、私としては様々な種類があるという認識です。昔は非常に精度の高いIMUとして光ファイバーのジャイロセンサーなどがあり、ジャイロとしては非常に高性能でしたが、価格も高価だったと記憶しています。

しかし、最近は先ほどおっしゃったように数百円程度で手に入るのですね。これは、いわゆる基板に半導体として集積されているMEMSセンサーを使用しているということですか?

井上: はい。先ほど紹介した自己位置推定モジュールではMEMS(Micro Electro Mechanical Systems)のものになります。

山口: MEMSは半導体で機械的な構造を作り、それで様々な計測や制御を行うデバイスの総称ですね。加速度を計測する際には、例えば静電容量の変化などを利用するのでしょうか?

井上:そうですね。 電子センサーの中に非常に小さなコンデンサーがあり、加速度がかかると慣性力が働き隙間が小さくなります。そうするとコンデンサーの静電容量が変化して電圧が変わるので、その電圧の変化を検知することで、現在どれだけ加速しているかが分かるのがMEMS IMUの仕組みになります。

山口: これが現在非常に低コストで、おそらくスマートフォンなどで普及したことで大量生産されてコストも下がってきているのでしょうね。このあたりも、私たちが自動運転で使うセンサーのコストにも影響し、安価に入手できるようになっているのかなと思います。

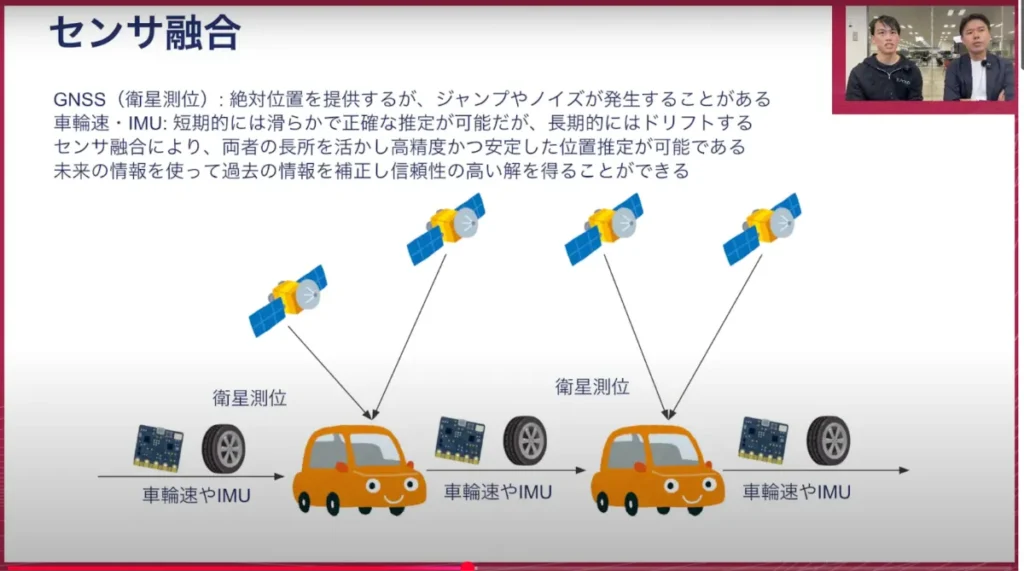

井上: 先ほどGNSSの衛星測位とIMU、車輪速度センサーについてそれぞれ説明しましたが、これらをどのように融合するかについてお話しします。

GNSSは一般的に「絶対位置」を提供し、地球上のどこにいるかがわかります。しかし、例えばGoogleマップなどを見ていると時々「ここにいたのに、一瞬自分の位置が消えて、急に遠くに飛ぶ」といったジャンプ現象が起こったり、また止まっているのに位置がばらついたりする課題があります。

一方で車輪速度センサーでは、スピードと時間があればどれだけ進んだかがわかります。また、先ほどの加速度センサーやジャイロセンサー(角速度)を使えば、非常に短い間隔で位置を測ることができます。

しかし、例えば時速100kmで1時間走り続けたとして、本当に100km進んでいるかと言われると、非常に長い積分していくと誤差が蓄積されていってしまいます。これが車輪速度センサーやIMUで測位する際の課題で、長期的にドリフトしてしまう問題があります。

この課題を解決するためにセンサー融合(センサーフュージョン)を行います。GNSSによる絶対的な位置情報と、IMUや車輪速度センサーによって短期間で得られる正確な数値を組み合わせて推定していく手法です。

山口:つまりGPSやGNSSで位置が出るならそれで終わりかと思いましたが、やはり高架下やトンネルに入ると衛星信号が届かず、現在位置が分からなくなってしまうのですね。そこで他のセンサー、IMUや車両のタイヤの速度など、他のセンサーを使ってその弱点を補うのがセンサーフュージョンの目的ですね。

センサーフュージョンには様々なアプローチがあると思いますが、例えばカルマンフィルターを使うのが一般的ですよね。

井上: はい、有名なところはカルマンフィルターで、この図もカルマンフィルターをイメージして作成したものです。ある状態から車輪速やIMUを使って、例えば0.1秒後にどこにいるだろうというのを推測します。

次に、GPSから位置情報が入力され、それが「答え合わせ」のような役割を果たします。車輪速度やIMUで算出した位置と、GPSの位置を比較して、ちょうど良いバランスで「現在ここにいるだろう」という位置を推定します。これを繰り返して、また車輪速度で次の場所を推定し、衛星測位からの入力と比較して融合し、次に計算を進めていく、というのがカルマンフィルターです。

もう一つ有名なのがグラフ最適化です。この図で言うと、車両を「ノード」とし、その間を結ぶ車輪速度やIMUなどを「エッジ」として、それらを最適化計算することで、現在「ここ」にいるだろうという位置を推定します。有名なものとしては、カルマンフィルターかグラフ最適化のどちらかになるかと思います。

山口: カルマンフィルターは知っていましたが、グラフ最適化でセンサーフュージョンを実際にやっているという話は詳しくなかったので、やはり両方とも使われているのですね。

それらは使い分けられているのですか?

井上: カルマンフィルターは、このような車両の運動などによく使われます。一方でグラフ最適化は、例えばロボットで道を1周した際に、カメラや車輪速度、IMUで走行すると、1周して戻ってきたときに本来同じ位置に戻るはずなのに少しずれてしまうという問題があります。

それを例えば「ここに同じ看板があったら、スタート地点とゴール地点で同じ看板なので、ここは同じ場所だろう」という制約条件を入れることで、例えば四角形に移動したのなら四角形に移動する。というループクローズといったものにも使えるのがグラフ最適化です。ロボットの自己位置推定などではよく使われます。

山口: なるほど。逆に私たちのような車両の場合には、カルマンフィルターの方が使いやすいイメージですか?

井上:グラフ最適化も計算負荷が高いため、どちらが適しているかは状況によりますので、どちらが良い悪いという話ではなく、適材適所で使用する必要があります。

山口: 少し話がそれますが、カルマンフィルターや先ほどのジャイロスコープなどは、比較的古くから開発されているセンサーだと思います。おそらくアポロ計画など、そのような時に最初に導入されたのではないでしょうか。アポロ計画は月まで人を送り込まなければならなかったので、宇宙船の姿勢や位置を正確に推定しないと月までたどり着けないということで、そのあたりの技術が非常に発達したと聞いています。その時代、コンピューターもまだ未発達だったのに、カルマンフィルターがソフトウェアとして存在していたという話を聞いたことがあり、すごいなと思ったことがあります。そういった話があったことを思い出しました。

このセンサーフュージョンを、私たちも自社のデバイスで実現していくということですね。

井上: せっかくなので、現在データ収集車両が撮影した実際のデータを見ていただきたいと思います。これは動画になっていて、おそらく2分程度ですが、2倍速か3倍速に設定されています。左側が地図で、中央にあるオレンジ色の矢印が現在の車両の位置です。右側が前方カメラの映像です。ここは非常に開けている場所なのでGPSがうまく測位できています。そのため交差点の手前で停車しているのも、ぴったり交差点の前の位置を出してくれていますね。

山口: かなり細かな場所も正確にわかるのですね。

井上: その通りです。センチ単位でわかります。

山口: これがまさに先ほどお話しした様々なセンサー、GNSS、IMU、車輪速度を含めてセンサーフュージョンを行った結果、究極的にはセンチ単位で精度が出るんですね。

自動運転においては車線のどこを走行しているか、どの車線にいるかといった情報は、当然運転において非常に重要になってきます。データ収集時において、車両がどこを走行したかという情報はAIモデルが学習する際に極めてクリティカルになってきます。そのため、この位置が非常に正確に分かっているというのは、非常に強力な強みですね。

ちなみに、これは私たち自身で撮影した東京都内のデータで、このマップも私たちが作成したマップのデータセットです。実は東京都内中の道の車線情報や交差点、横断歩道の位置情報などもすべて自社で保有しており、それをセンサー情報と組み合わせてマッピングしています。

井上: 先ほどGPS、つまり衛星信号を使用しているとお話ししました。しかし、一般的には例えば高架下などを通る際、GPSだけでは位置が分からなくなってしまいます。位置が分からないというよりも、数センチ単位での精度は得られなくなります。しかし先ほどお話ししたIMUや車輪速度といった情報を組み合わせると、高架下でも正確にマップの中でどこにいるかを推定できています。

山口: 伝わりづらかったかもしれませんが、高架下ではGNSSの情報を取得するのが非常に難しいです。基本的にGNSSは空に衛星が浮いているため、ビルの間や高架下に入っただけでも一瞬で情報が取れなくなってしまう状態になります。しかし先ほどお話ししたように、そういった状況でも滑らかに車両の位置が正確に分かっているというのは、やはりすごいことですね。

私も自分で車を運転しますが、特に東京都内で首都高の下にいる時など、ナビが誤認識してあたかも自分が首都高上にいるかのように表示されることがあります。このようにナビがおかしくなってしまう経験がある方もいらっしゃるかもしれません。しかしこのあたりが非常に高精度で取得できるというのは、自動運転のデータを扱う上で非常に重要ということですね。

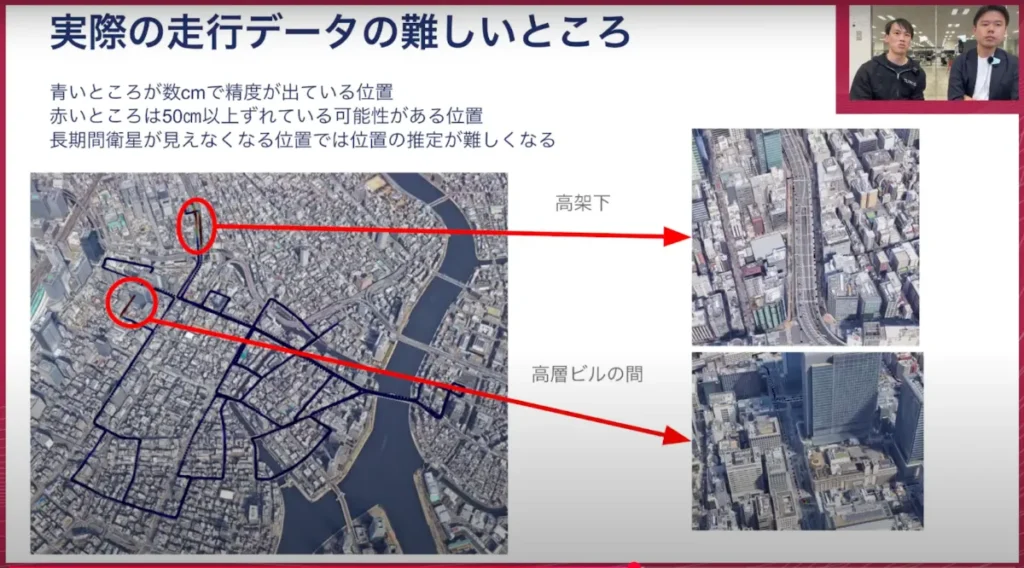

井上: その通りです。先ほどは実際に非常に滑らかなデータを見ていただきましたが、その中には難しいところもあります。左の図は少し見にくいですが、青い部分と赤丸で囲まれている部分が、精度が悪くなっているところです。青い部分は、車両が数センチメートル以内の精度でほぼ位置が分かっているところなのですが、どうしても高架下を長い間走行していると、先ほどお話ししたIMUや車輪速度の誤差が蓄積されてドリフトしてしまう問題があります。

やはり高架下を非常に長い時間走行していると、少しずつずれていったり、高架下でなくても高いビルの間を走行していくと徐々にずれていったりするものですので、実際にデータを取得してみると位置がうまく算出されていない問題はあります。

山口: そういった意味では、自己位置推定である程度の自分の位置はわかるものの、やはり車両は常に走行し続けなければなりません。また私たちのデータ収集も、1回のトリップで数時間ずっと車両を走行させている間に、自分の位置が本来想定している位置からずれてドリフトしてしまうという問題があり、これをいかに正確な位置を把握するかが重要になってくるということですね。

井上: もし高架下のデータが取得できずに、そこが学習できなかったとしたら、自動運転モデルとしては高架下に入った瞬間にどうやって進んでいいかわからなくなってしまうモデルができてしまいます。こういったところも、様々なセンサーを使って正確な位置を算出していく自己位置推定の難しいところであり、取り組むべき課題ですね。

山口: ありがとうございます。ここまで自己位置推定の全般的なところや、チューリングが取り組んでいることなどをお話ししていただきました。

やはり次世代自動運転、私たちが取り組んでいるようなE2Eの自動運転において、自己位置推定の目的は、自動運転AIが学習するためのデータに非常に正確な位置情報、つまり車両がどのような軌跡をたどったかを正確に知っておくことが重要だと考えています。これが正確でないと、AIが間違った学習をしてしまう可能性があるからです。

そういった観点から見ると、やはり一般的なロボットで使う自己位置推定や、2000年代から使われているようなセンサーベースの自己位置推定を行いながら、LiDARなどのモジュールで自動運転を行うといった技術とはかなり方針が異なってくるのでしょうか。

井上: 今までのセンサーベースやルールベースの移動ロボットや自動運転車では、リアルタイムで現在どこにいて、進みたい経路に対してどれくらいずれているかが重要でした。

しかしAIベースの自動運転では、データを取得して後処理を行うことに重点を置いています。後処理でできるだけ正確に、この車両がどのような状態であったかを推定し、例えば車両がどのような運動をしたかが正確に分かれば、この運転は良かった、もしくはこの運転は悪かったと分かります。そのため、なるべく多くの「良い運転」を学習させることで、上手に運転できるモデルが出来上がると思います。

山口: 繰り返しになりますが、弊社の自動運転のアプローチは、カメラと賢いAIでリアルタイムに行っています。そのため、今回お話ししたような自己位置推定はリアルタイムで実行する必要がなく、あくまでカメラベースのAIの部分を学習するためのデータを作成するために行っています。そのため、その精度を究極的に追求さえすれば、どれだけ後処理に時間がかかっても問題ないということになりますね。

ですから車両が走行して、あるT0の自己位置を推定したいときに、未来の情報も使ってもいいわけですね。T+1、T+2の情報を活用することで、例えば高架下に入って一時的にGNSSの信号が途切れた際でも、高架下を抜けた後の情報を使えば、高架下の位置をよりロバストに推定しやすくなります。

井上: リアルタイムでは、例えば高架下に入った後に位置がジャンプして、それまで分からなかった位置が急に正しい位置に飛んでしまうことがあります。未来の情報を活用することで、「将来ここにいるのだから、ここではなくここだろう」といった、より精度の高い位置を算出できるのが、この後処理の大きな特徴です。

山口: そういった意味では、現在私たちもセンサーモジュールを開発していて、リアルタイムでも自己位置を推定できる仕組みにはなっていると思います。しかしどちらかというと主眼としては、自分たちでデータを取得する際にセンサーを搭載し、それを取得してクラウドなどにアップロードした後に、後処理でより正確な位置を知る設計をしているということですね。

具体的に、後処理で自己位置推定をする場合に、未来の情報を使える以外にリアルタイムとの技術的な違いはありますか?

井上: やはり計算コストでしょうか。クラウドに上がってからであれば、非常に時間がかかっても許容される点だと思います。

山口: 先ほどのグラフ最適化のような話もそれなりに重たい計算を実行しなければならないので、リアルタイムでミリ秒単位で実行するのはかなり困難な計算だと思いますが、そういったものも後処理であれば自由に行えるということですよね。

チューリングでは現在データ収集時間が1万時間を超えていますが、そういった全ての走行データに適用することもできるはずですね。私たちは数PBの走行データにスケールできる、そして精度高くAI学習に使えるような究極の精度の自己位置推定を実現させようと、現在取り組んでいるところです。

※以降では、参加者との質疑応答が展開されました。本イベントの全内容は、ぜひ以下のリンクからご覧ください。

【イベント概要】

Turing Tech Talk #17 次世代自動運転を支える自己位置推定 多センサー融合による精度と信頼性の追求

https://www.youtube.com/watch?v=V5zbI2hTfTA